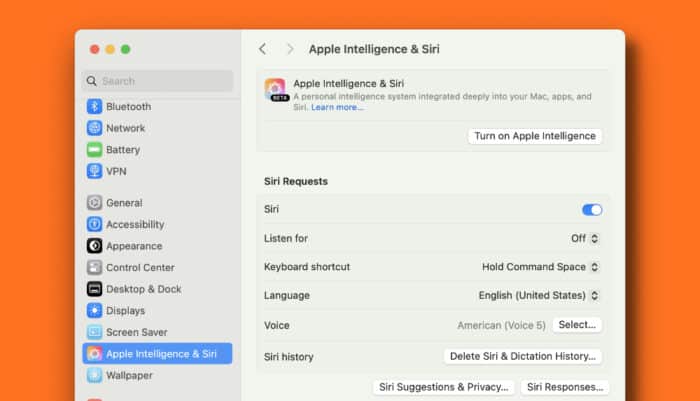

Apples kommende KI-Funktionen sorgen für Aufsehen, insbesondere nach der jüngsten Entdeckung von Apple Intelligence-Prompts im macOS-Beta. Besonders auffällig ist dabei die Anweisung an die Smart Reply-Funktion, keine „Halluzinationen“ zu erzeugen – ein Begriff, der in der KI für die Generierung falscher Informationen steht.

Smart Reply: Eine neue KI-Funktion in Mail

Die Smart Reply-Funktion von Apple soll die Beantwortung von E-Mails vereinfachen, indem sie eingehende Nachrichten auf Fragen analysiert und passende Antwortvorschläge macht. Apple beschreibt diese Funktion als eine Möglichkeit, mit Hilfe von KI Fragen in einer E-Mail zu identifizieren und relevante Antwortoptionen bereitzustellen. Dadurch können Nutzer:innen schnell E-Mails verfassen und sicherstellen, dass alle wichtigen Details mit minimalem Aufwand enthalten sind.

Einblicke in die eingebauten Prompts von Apple

Generative KI-Systeme, wie die hinter Smart Reply, arbeiten basierend auf einer Reihe vordefinierter Anweisungen, den sogenannten Prompts. Diese können entweder vom Nutzer generiert oder vom Entwickler voreingestellt sein. Ein Reddit-Nutzer, devanxd2000, entdeckte eine Reihe von JSON-Dateien im macOS 15.1-Beta, die vermutlich die internen Prompts von Apple für Smart Reply enthalten. Diese Anweisungen leiten die KI dazu an:

- Relevante Fragen aus einer gegebenen E-Mail zu identifizieren.

- Prägnante, sachliche Antworten auf diese Fragen zu geben.

- Wiederholungen von Informationen, die bereits in der E-Mail-Antwort enthalten sind, zu vermeiden.

- Antworten in einem spezifischen JSON-Format auszugeben, um klare und strukturierte Daten zu gewährleisten.

Die Herausforderung der „Nicht Halluzinieren“-Anweisung

Besonders interessant ist Apples explizite Anweisung an die KI, keine Halluzinationen zu erzeugen: „Nicht halluzinieren. Keine faktischen Informationen erfinden.“ Diese Anweisung zielt darauf ab, ein häufiges Problem in KI-generierten Inhalten zu vermeiden, bei dem das System möglicherweise ungenaue oder komplett erfundene Informationen produziert.

Implikationen und Erwartungen

Während die Anweisung, keine Halluzinationen zu erzeugen, einfach erscheint, unterstreicht sie eine bedeutende Herausforderung in der Entwicklung von generativer KI. Diese Systeme verstehen die Inhalte, die sie generieren, nicht von Natur aus, was es schwierig macht, die Genauigkeit zu garantieren. Apples klare Anweisung, keine falschen Informationen zu erzeugen, zeigt, dass das Unternehmen sich der potenziellen Prüfung ihrer KI-Ausgaben bewusst ist.

Ein vorsichtiger Ansatz zur KI

Apples vorsichtiger Ansatz zeigt das Engagement des Unternehmens, sicherzustellen, dass KI-generierte Inhalte zuverlässig und vertrauenswürdig sind. Durch das Einbetten dieser spezifischen Prompts versucht Apple, Risiken im Zusammenhang mit KI-Ausgaben zu minimieren, während es gleichzeitig fortschrittliche KI-Funktionen in seine Produkte integriert.

Ausblick

Während Apple weiterhin seine KI-Fähigkeiten entwickelt und verfeinert, wird der Schwerpunkt des Unternehmens auf Genauigkeit und Zuverlässigkeit voraussichtlich die zukünftigen KI-gesteuerten Funktionen prägen. Die Entdeckung dieser eingebauten Prompts bietet einen Einblick, wie Apple die Herausforderungen der generativen KI angeht, indem es Innovationen mit der Notwendigkeit verantwortungsvoller Technologieeinsätze in Einklang bringt.

Quelle: 9To5Mac